爬虫框架WebMagic

架构解析

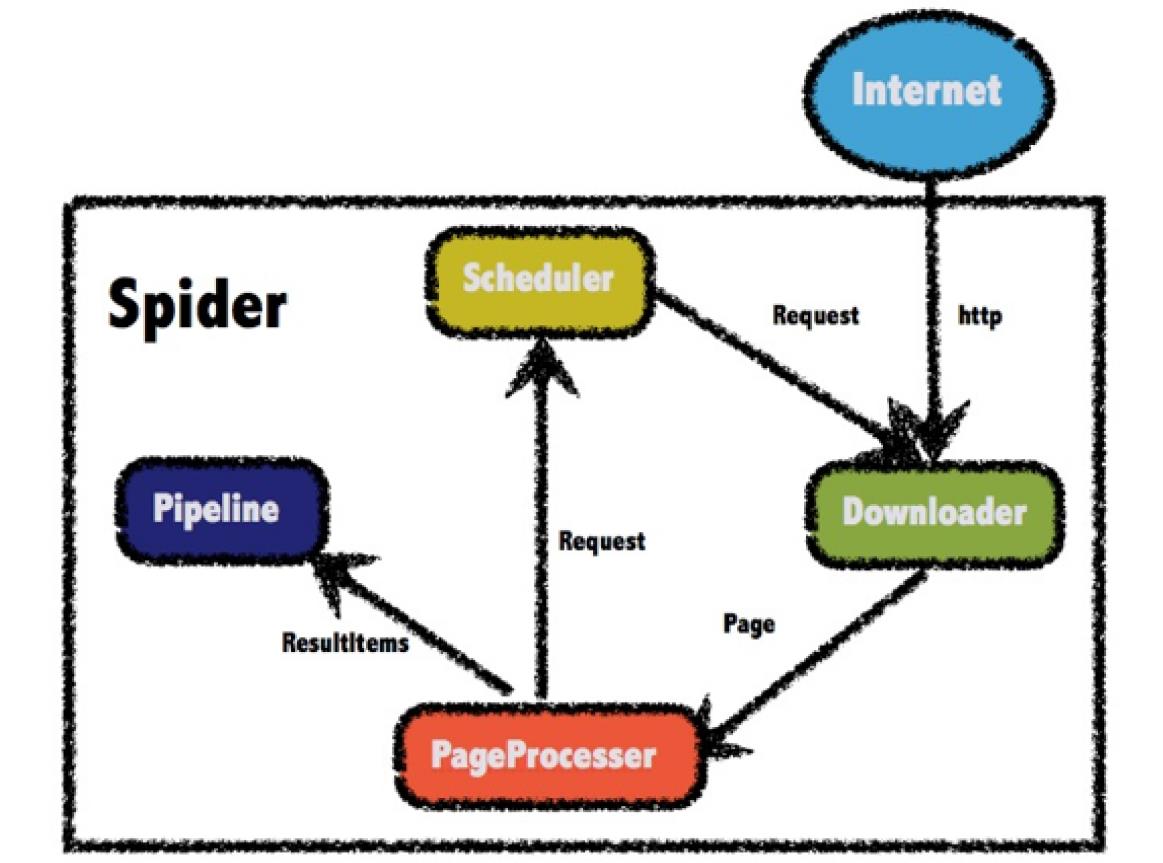

WebMagic的设计目标是尽量的模块化,并体现爬虫的功能特点。这部分提供非常简单、灵活的API,在基本不改变开发模式的情况下,编写一个爬虫。

WebMagic的结构分为Downloader、PageProcessor、Scheduler、Pipeline四大组件,并由Spider将它们彼此组织起来。这四大组件对应爬虫生命周期中的下载、处理、管理和持久化等功能。而Spider则将这几个组件组织起来,让它们可以互相交互,流程化的执行,可以认为Spider是一个大的容器,它也是WebMagic逻辑的核心。

WenMagic组件:

Downloader

Downloader负责从互联网上下载页面,以便后续处理。WebMagic默认使用了ApacheHttpClient作为下载工具。

PageProcesser

PageProcessor负责解析页面,抽取有用信息,以及发现新的链接。WebMagic使用

Jsoup作为HTML解析工具,并基于其开发了解析XPath的工具Xsoup。在这四个组件中,PageProcessor对于每个站点每个页面都不一样,是需要使用者定制的部分。

Scheduler

Scheduler负责管理待抓取的URL,以及一些去重的工作。WebMagic默认提供了JDK的内存队列来管理URL,并用集合来进行去重。也支持使用

Redis进行分布式管理。Pipeline

Pipeline负责抽取结果的处理,包括计算、持久化到文件、数据库等。WebMagic默认提供了“输出到控制台”和“保存到文件”两种结果处理方案。

API

Spider API

| 方法 | 说明 | 示例 |

|---|---|---|

| create(PageProcessor) | 创建Spider | Spider.create(new GithubRepoProcessor()) |

| addUrl(String…) | 添加初始的URL | Spider.addUrl(“http://webmagic.io/docs/") |

| thread(n) | 开启n个线程 | Spider.thread(5) |

| run() | 启动,会阻塞当前线程执行 | Spider.run() |

| start()/runAsync() | 异步启动,当前线程继续执行 | Spider.start() |

| stop() | 停止爬虫 | Spider.stop() |

| addPipeline(Pipeline) | 添加一个Pipeline,一个Spider可以有多个Pipeline | Spider .addPipeline(new ConsolePipeline()) |

| setScheduler(Scheduler) | 设置Scheduler,一个Spider只能有一个Scheduler | Spider.setScheduler(new RedisScheduler()) |

| setDownloader(Downloader) | 设置Downloader,一个Spider只能有一个Downloader | Spider.setDownloader(new SeleniumDownloader()) |

| get(String) | 同步调用,并直接取得结果 | ResultItems result = Spider.get(“http://webmagic.io/docs/") |

| getAll(String…) | 同步调用,并直接取得一堆结果 | List results = Spider.getAll(“http://webmagic.io/docs/","http://webmagic.io/xxx") |

同时Spider的其他组件(Downloader、Scheduler、Pipeline)都可以通过set方法来进行设置。

Site API

| 方法 | 说明 | 示例 |

|---|---|---|

| setCharset(String) | 设置编码 | site.setCharset(“utf-8”) |

| setUserAgent(String) | 设置UserAgent | site.setUserAgent(“Spider”) |

| setTimeOut(int) | 设置超时时间, 单位是毫秒 | site.setTimeOut(3000) |

| setRetryTimes(int) | 设置重试次数 | site.setRetryTimes(3) |

| setCycleRetryTimes(int) | 设置循环重试次数 | site.setCycleRetryTimes(3) |

| addCookie(String,String) | 添加一条cookie | site.addCookie(“dotcomt_user”,”code4craft”) |

| setDomain(String) | 设置域名,需设置域名后,addCookie才可生效 | site.setDomain(“github.com”) |

| addHeader(String,String) | 添加一条addHeader | site.addHeader(“Referer”,”https://github.com") |

| setHttpProxy(HttpHost) | 设置Http代理 | site.setHttpProxy(new HttpHost(“127.0.0.1”,8080)) |

| setSleepTime | 间隔时间设置 | site.setSleepTime(100) |

PageProcessor

爬取页面全部内容

需求:编写爬虫程序,爬取csdn中博客的内容 https://blog.csdn.net/

创建工程,引入依赖

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.xushuai</groupId>

<artifactId>webmagic_demo</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>us.codecraft</groupId>

<artifactId>webmagic-core</artifactId>

<version>0.7.3</version>

</dependency>

<dependency>

<groupId>us.codecraft</groupId>

<artifactId>webmagic-extension</artifactId>

<version>0.7.3</version>

</dependency>

</dependencies>

</project>实现页面爬取

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29package com.xushuai.magic.spider;

import us.codecraft.webmagic.Page;

import us.codecraft.webmagic.Site;

import us.codecraft.webmagic.Spider;

import us.codecraft.webmagic.pipeline.ConsolePipeline;

import us.codecraft.webmagic.processor.PageProcessor;

/**

* Spider Class Demo

*/

public class PageProcessorDemo1 implements PageProcessor {

public void process(Page page) {

System.out.println(page.getHtml().toString());

}

public Site getSite() {

return Site.me().setSleepTime(100).setRetryTimes(3);

}

public static void main(String[] args) {

Spider.create(new PageProcessorDemo1())

// 添加爬取的主网站

.addUrl("https://www.csdn.net/")

.run();

}

}

Page代表了从Downloader下载到的一个页面——可能是HTML,也可能是JSON或者 其他文本格式的内容。Page是WebMagic抽取过程的核心对象,它提供一些方法可供抽取、结果保存等。

Site用于定义站点本身的一些配置信息,例如编码、HTTP头、超时时间、重试策略等、代理等,都可以通过设置Site对象来进行配置。

爬取指定内容

使用xpath来抓去网页指定部分内容

1 | page.getHtml().xpath("//*[@id=\"nav\"]/div/div/ul/li[5]/a"); |

添加目标地址

添加目标地址,将目标地址中所有的链接添加到待爬取列表

1 | page.addTargetRequests(page.getHtml().links().all()); |

目标地址正则匹配

需求:只提取博客的文章详细页内容,并提取标题

1 | page.addTargetRequests(page.getHtml() |

Pipeline

ConsolePipeline 控制台输出(省略)

FilePipeline 文件输出

1 | public static void main(String[] args) { |

JsonFilePipeline Json输出

1 | public static void main(String[] args) { |

Custom Pipeline 自定义输出

编写自定义管道类

1

2

3

4

5

6

7

8

9

10

11

12

13

14package com.xushuai.magic.pipeline;

import us.codecraft.webmagic.ResultItems;

import us.codecraft.webmagic.Task;

import us.codecraft.webmagic.pipeline.Pipeline;

/**

* 自定义输出管道

*/

public class CustomPipeline implements Pipeline {

public void process(ResultItems resultItems, Task task) {

System.out.println(resultItems.get("title"));

}

}添加自定义管道

1

2

3

4

5

6

7

8

9

10

11

12

13

14public static void main(String[] args) {

Spider.create(new PageProcessorDemo1())

// 添加爬取的主网站

.addUrl("https://www.csdn.net/")

// 添加控制台输出管道

.addPipeline(new ConsolePipeline())

// 添加文件输出管道

.addPipeline(new FilePipeline("F:/data"))

// 添加Json输出管道

.addPipeline(new JsonFilePipeline("F:/json"))

// 添加自定义管道

.addPipeline(new CustomPipeline())

.run();

}

Scheduler

Scheduler(URL管理) 最基本的功能是实现对已经爬取的URL进行标示。可以实现URL的增量去重。

目前Scheduler主要有三种实现方式:

- 内存队列:QueueScheduler

- 文件队列:FileCacheQueueScheduler

- Redis队列:RedisScheduler

内存队列

1 | public static void main(String[] args) { |

文件队列

使用文件保存抓取URL,可以在关闭程序并下次启动时,从之前抓取到的URL继续抓取。

1 | public static void main(String[] args) { |

Redis队列

使用Redis保存抓取队列,可进行多台机器同时合作抓取。

1 | public static void main(String[] args) { |

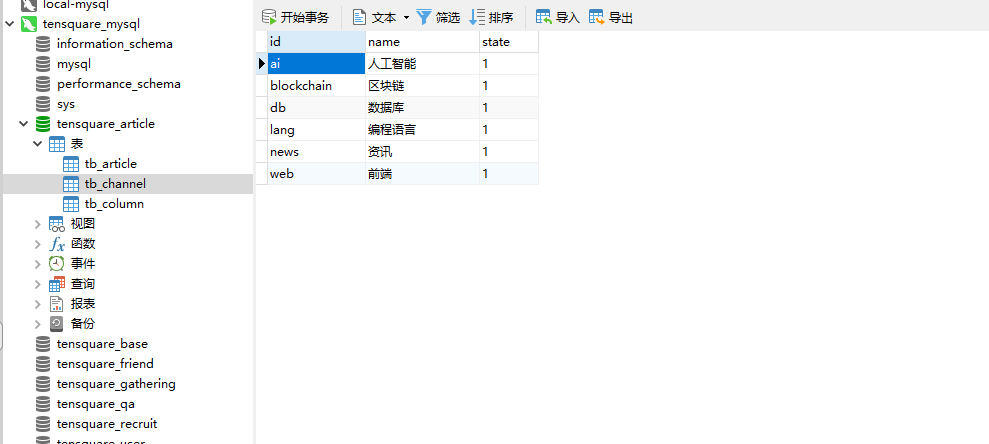

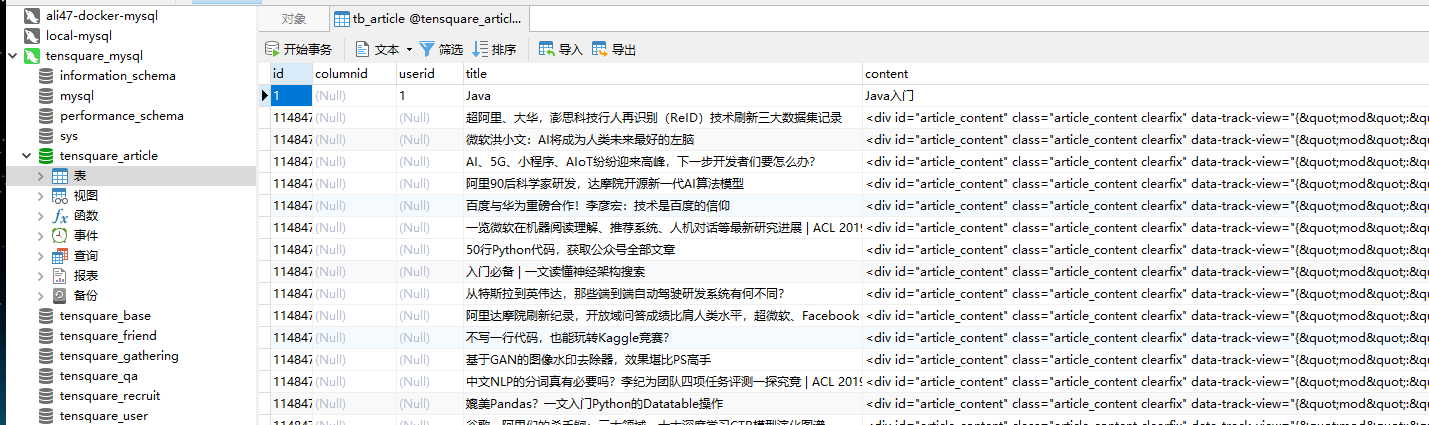

十次方文章数据爬取

需求:每日某时间段从CSDN播客中爬取文档,存入文章数据库中。

准备工作

CSDN中各个频道的地址

| 频道名称 | 地址 |

| ——– | ———————————— |

| 资讯 | https://blog.csdn.net/nav/news |

| 人工智能 | https://blog.csdn.net/nav/ai |

| 区块链 | https://blog.csdn.net/nav/blockchain |

| 数据库 | https://blog.csdn.net/nav/db |

| 前端 | https://blog.csdn.net/nav/web |

| 编程语言 | https://blog.csdn.net/nav/lang |向数据库

tensquare_article中的tb_channel表中添加记录

文章爬取微服务

创建Module

pom.xml

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<parent>

<artifactId>tensquare_parent</artifactId>

<groupId>com.tensquare</groupId>

<version>1.0.0-SNAPSHOT</version>

</parent>

<modelVersion>4.0.0</modelVersion>

<artifactId>tensquare_article_crawler</artifactId>

<dependencies>

<dependency>

<groupId>us.codecraft</groupId>

<artifactId>webmagic-core</artifactId>

<version>0.7.3</version>

<exclusions>

<exclusion>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-log4j12</artifactId>

</exclusion>

</exclusions>

</dependency>

<dependency>

<groupId>us.codecraft</groupId>

<artifactId>webmagic-extension</artifactId>

<version>0.7.3</version>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-data-jpa</artifactId>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

</dependency>

<dependency>

<groupId>com.tensquare</groupId>

<artifactId>tensquare_common</artifactId>

<version>${tensquare.version}</version>

</dependency>

</dependencies>

</project>application.yml

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15server:

port: 9014

spring:

application:

name: tensquare-crawler

datasource:

driver-class-name: com.mysql.jdbc.Driver

url: jdbc:mysql://192.168.136.104:3306/tensquare_article?characterEncoding=UTF8

username: root

password: 123456

jpa:

database: mysql

show-sql: true

redis:

host: 192.168.136.104启动类

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31package com.tensquare.crawler;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.context.annotation.Bean;

import org.springframework.scheduling.annotation.EnableScheduling;

import us.codecraft.webmagic.scheduler.RedisScheduler;

import util.IdWorker;

public class CrawlerApplication {

("${spring.redis.host}")

private String REDIS_HOST;

public static void main(String[] args) {

SpringApplication.run(CrawlerApplication.class, args);

}

public IdWorker idWorker() {

return new IdWorker(1, 11);

}

public RedisScheduler redisScheduler() {

return new RedisScheduler(REDIS_HOST);

}

}

- 复制文章实体类以及数据访问接口(省略)

爬取类(PageProcessor)

1 | package com.tensquare.crawler.processor; |

入库类(Pipeline)

1 | package com.tensquare.crawler.pipeline; |

任务(Task)

1 | package com.tensquare.crawler.task; |

注意:addUrl(url)中添加的路径一定要以/结尾。

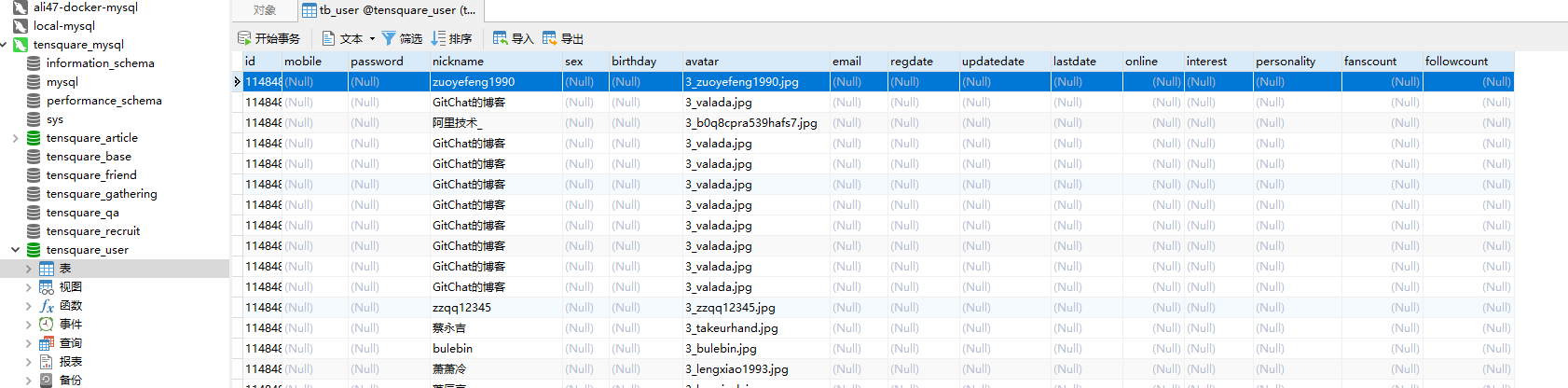

十次方用户数据爬取

从csdn中爬取用户昵称和头像,存到用户表,头像图片存储到本地。

用户爬取微服务

创建Module

pom.xml(省略,与文章数据爬取微服务一致)

application.yml

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15server:

port: 9015

spring:

application:

name: tensquare-user-crawler

datasource:

driver-class-name: com.mysql.jdbc.Driver

url: jdbc:mysql://192.168.136.104:3306/tensquare_user?characterEncoding=UTF8

username: root

password: 123456

jpa:

database: mysql

show-sql: true

redis:

host: 192.168.136.104启动类

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31package com.tensquare.crawler;

import org.springframework.beans.factory.annotation.Value;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

import org.springframework.context.annotation.Bean;

import org.springframework.scheduling.annotation.EnableScheduling;

import us.codecraft.webmagic.scheduler.RedisScheduler;

import util.IdWorker;

public class UserCrawlerApplication {

("${spring.redis.host}")

private String REDIS_HOST;

public static void main(String[] args) {

SpringApplication.run(UserCrawlerApplication.class, args);

}

public IdWorker idWorker() {

return new IdWorker(1, 11);

}

public RedisScheduler redisScheduler() {

return new RedisScheduler(REDIS_HOST);

}

}复制用户实体类以及数据访问接口(省略)

下载工具类

在tensquare_common中添加下载工具类

1 | package util; |

爬取类(PageProcessor)

1 | package com.tensquare.crawler.processor; |

入库类(Pipeline)

1 | package com.tensquare.crawler.pipeline; |

任务类(Task)

1 | package com.tensquare.crawler.task; |

注意:addUrl方法以/结尾

爬取效果

文章数据

用户数据

用户数据

用户头像